【Novikoff 定理】

设训练集 $D=\{(\mathbf{x}_1,y_1),(\mathbf{x}_2,y_2),…,(\mathbf{x}_N,y_N)\}$ 是是线性可分的,第 $i$ 组样本中的输入 $\mathbf{x}_i$ 具有 $n$ 个特征值,即:$\mathbf{x}_i=(x_i^{(1)},x_i^{(2)},…,x_i^{(n)})\in \mathbb{R}^n$,输出 $y_i\in\mathcal{Y}=\{+1,-1\}$,则:

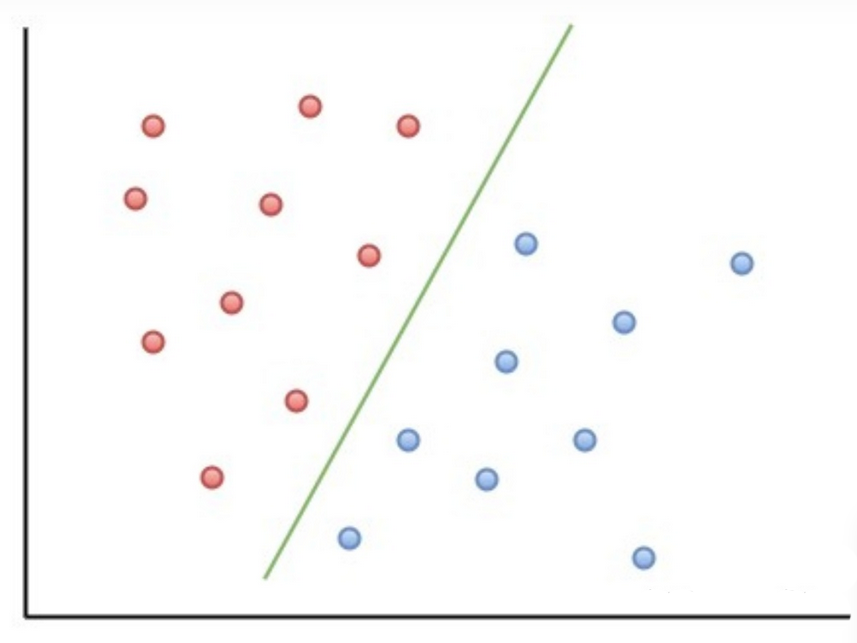

- 存在满足条件 $||W_{opt}||_2=1$ 的超平面 $S:W_{opt}X=\boldsymbol{\omega}_{opt}\cdot\mathbf{x}+\theta_{opt}=0$ 将训练集完全正确分开,且存在 $\gamma>0$,对所有的 $i=1,2,…,N$,有: